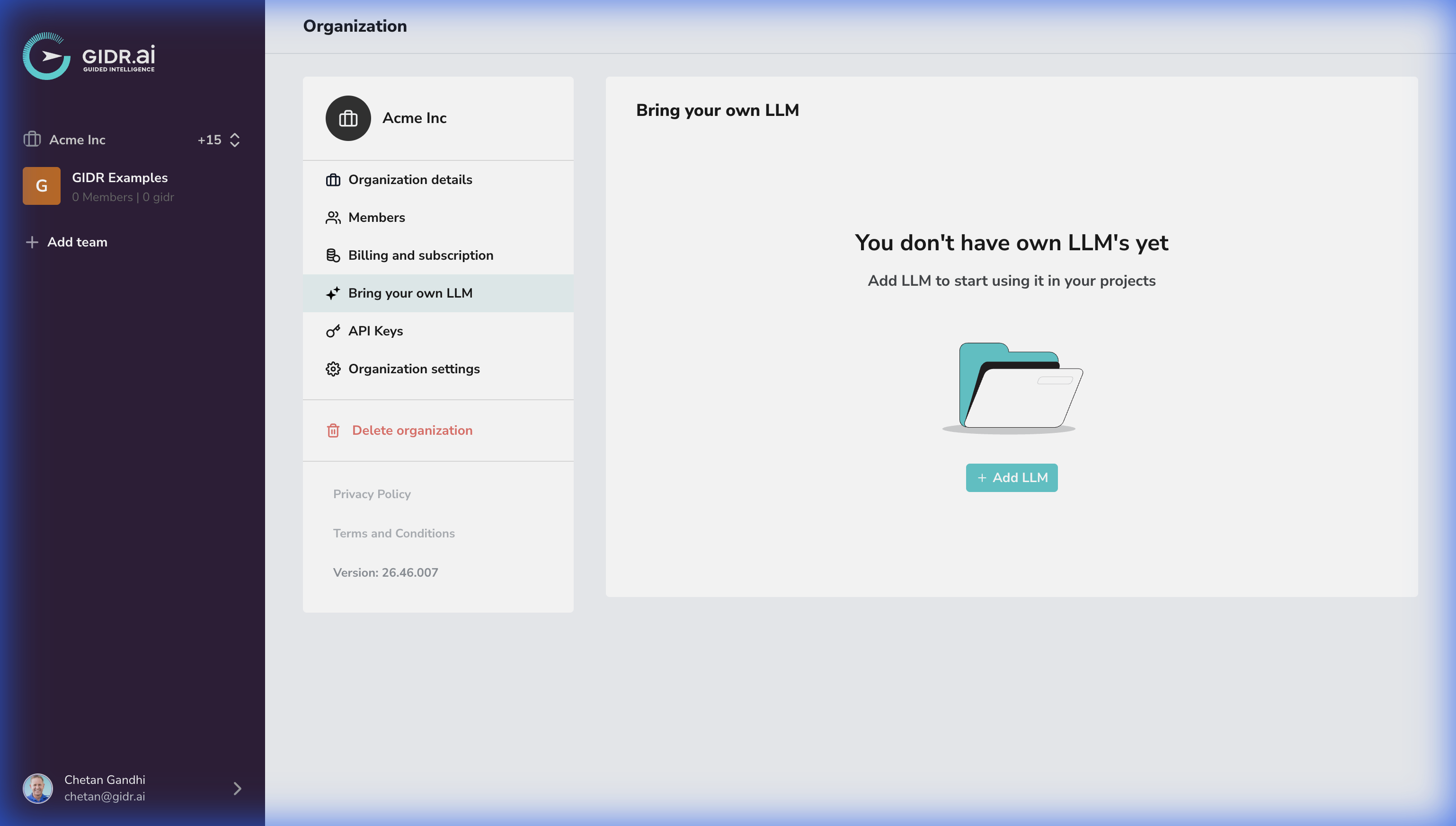

サポートされているプロバイダー

以下のAPIキーを設定できます:- OpenAI

- Azure OpenAI

- Anthropic

- Gemini

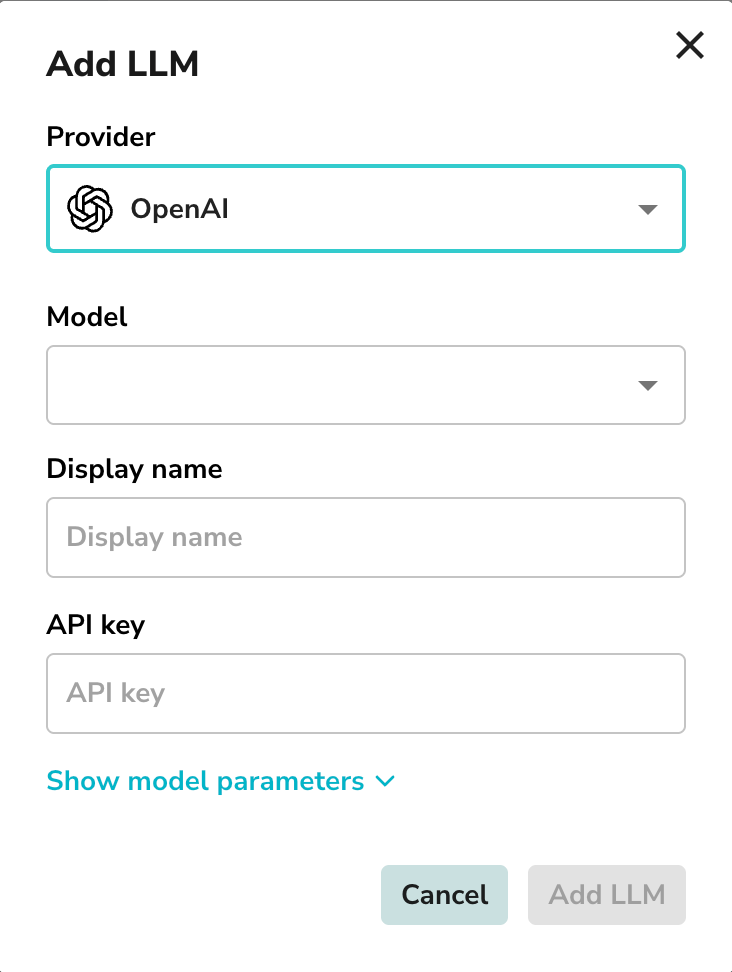

OpenAI

OpenAIをプロバイダーとして追加するには、OpenAIエンドポイントの詳細を提供する必要があります。

- プロバイダー: OpenAI を選択します。

- モデル: 必要に応じて特定のモデルを選択します。

- 表示名: この設定を識別するための名前を入力します。

- APIキー: 有効なOpenAI APIキーを入力します。

- 温度 (Temperature): モデルの温度を調整します。

- 最大トークン: モデルの最大トークン数を設定します。

- 視覚機能: 必要に応じて視覚機能を有効にします。

- 音声機能: 必要に応じて音声機能を有効にします。

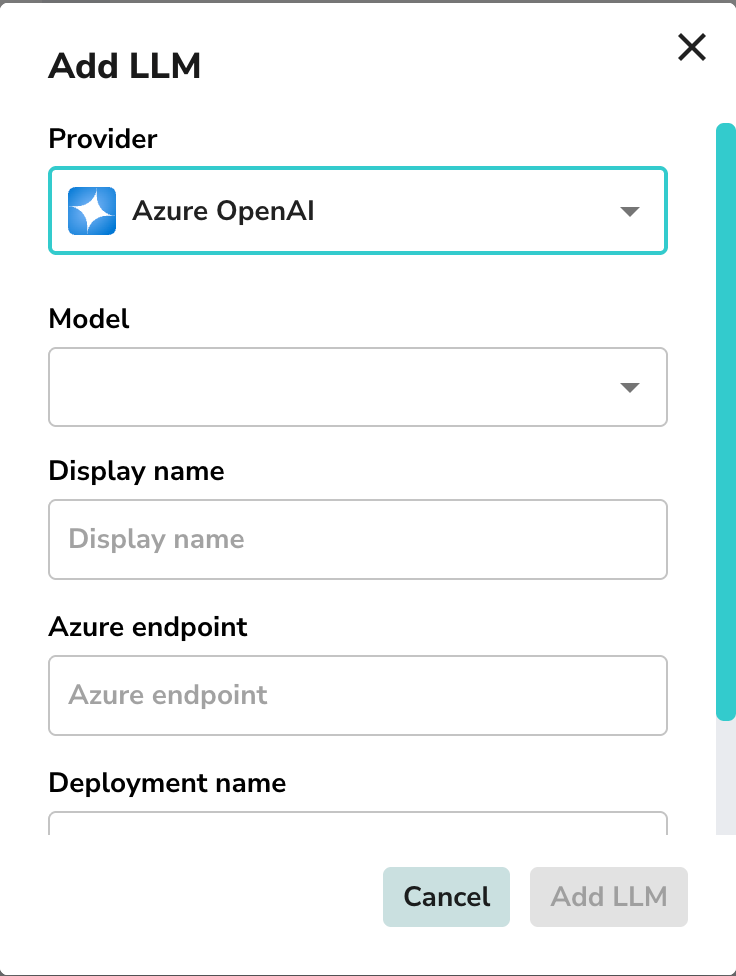

Azure OpenAI

Azure OpenAIの場合、Azure OpenAIエンドポイントの詳細を提供する必要があります。

- プロバイダー: Azure OpenAI を選択します。

- モデル: 使用するモデルを選択します。

- 表示名: このデプロイメントの名前を入力します。

- Azureエンドポイント: Azure OpenAIエンドポイントURLを入力します。

- デプロイメント名: Azureポータルからの特定のデプロイメント名を入力します。

- APIバージョン: モデルのAPIバージョンを選択します。

- APIキー: 有効なAzure OpenAI APIキーを入力します。

- 温度 (Temperature): モデルの温度を調整します。

- 最大トークン: モデルの最大トークン数を設定します。

- 視覚機能: 必要に応じて視覚機能を有効にします。

- 音声機能: 必要に応じて音声機能を有効にします。

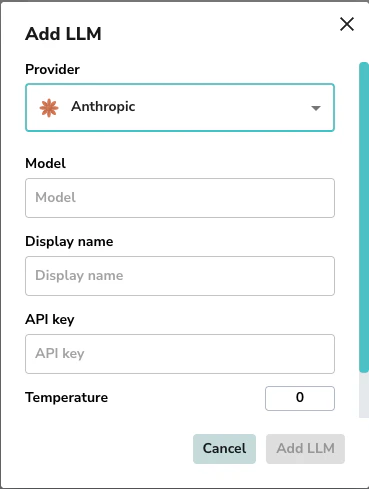

Anthropic

Anthropicをプロバイダーとして追加するには、Anthropicの詳細を提供する必要があります。

- プロバイダー: Anthropic を選択します。

- モデル: 使用するモデルを選択します。

- 表示名: この設定を識別するための名前を入力します。

- APIキー: 有効なAnthropic APIキーを入力します。

- 温度 (Temperature): モデルの温度を調整します (デフォルトは0)。

- 最大トークン: モデルの最大トークン数を設定します (デフォルトは32000)。

- 視覚機能: 必要に応じて視覚機能を有効にします。

- 音声機能: 必要に応じて音声機能を有効にします。

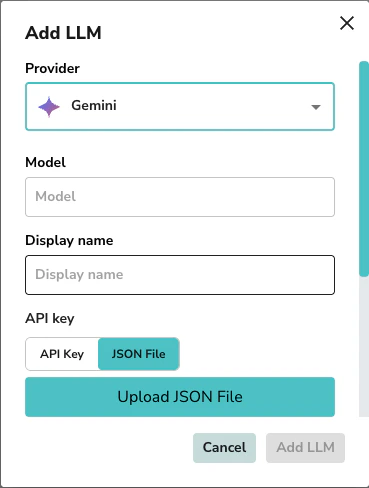

Gemini

Geminiをプロバイダーとして追加するには、Geminiの詳細を提供する必要があります。

- プロバイダー: Gemini を選択します。

- モデル: 使用するモデルを選択します。

- 表示名: この設定を識別するための名前を入力します。

- APIキーまたはJSONファイル: Googleサービスアカウント資格情報のJSONファイルをアップロードするか、APIキーを使用します。

- プロジェクト: Google Cloud プロジェクト ID を入力します (例:

my-gcp-project)。 - ロケーション: Google Cloud ロケーション を入力します (例:

us-central1)。 - 温度 (Temperature): モデルの温度を調整します (デフォルトは0)。

- 最大トークン: モデルの最大トークン数を設定します (デフォルトは32000)。

- 視覚機能: 必要に応じて視覚機能を有効にします。

- 音声機能: 必要に応じて音声機能を有効にします。